Local Coding dengan Qwen3-Coder-Next + Claude Code

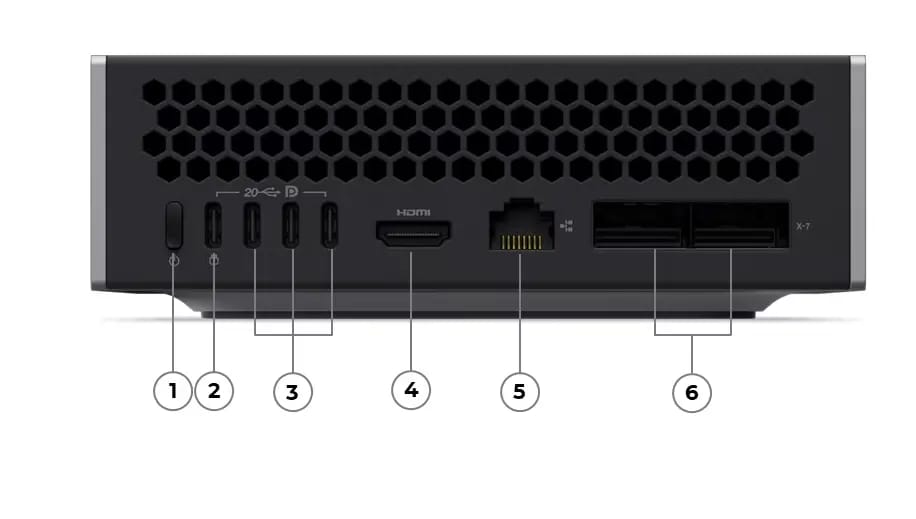

🖥️ Lenovo ThinkStation PGX

Banyak developer menjalankan LLM lokal lewat Ollama atau Open WebUI. Secara fungsional berjalan. Secara produktivitas sering mentok di autocomplete ringan.

Lonjakan performa terasa ketika Qwen3-Coder-Next dijalankan lokal dan dihubungkan ke Claude Code. Kombinasi tersebut mendekati pengalaman coding assistant berbasis cloud, namun seluruh proses berjalan di mesin sendiri.

Perangkat Keras Menjadi Penentu

Workstation yang digunakan berbasis arsitektur NVIDIA GB10 Grace Blackwell Superchip.

Spesifikasi kunci:

- 128GB unified LPDDR5x

- CPU dan GPU berbagi memori fisik

- Tanpa bottleneck PCIe khas GPU discrete

Model memiliki:

- 80B parameter total

- Mixture of Experts ultra-sparse

- ±3B parameter aktif per token

Dengan quantization Q4_K_M ukuran model sekitar 46GB.

Dengan Q8_0 penggunaan memori dapat mendekati 85GB dan masih menyisakan ruang besar untuk context window.

Karena unified memory, seluruh 128GB dapat diakses GPU tanpa perlu memindahkan tensor lintas bus PCIe. Pada sistem GPU discrete, model harus sepenuhnya masuk VRAM atau performa anjlok saat spill ke RAM.

Arsitektur Model dan Context Besar

Qwen3-Coder-Next dirancang untuk workflow agentic coding:

- Multi-step planning

- Tool calling

- File editing

- Recovery saat error

Attention menggunakan skema Gated DeltaNet hybrid 3:1:

- 75 persen linear attention tanpa growth KV cache

- 25 persen full attention

Implikasi praktis:

- Native context 256K token

- Context besar tetap usable secara lokal

- Konsumsi memori lebih efisien dibanding full attention murni

Pada context ±170K token, satu sesi bisa memuat:

- Fungsi hasil decompile lengkap

- Control flow di sekitarnya

- Instruksi analisis detail

Untuk reverse engineering dan analisis firmware, pendekatan ini signifikan karena tidak ada kebutuhan mengirim kode sensitif ke cloud, tidak ada rate limit, dan tidak ada biaya token.

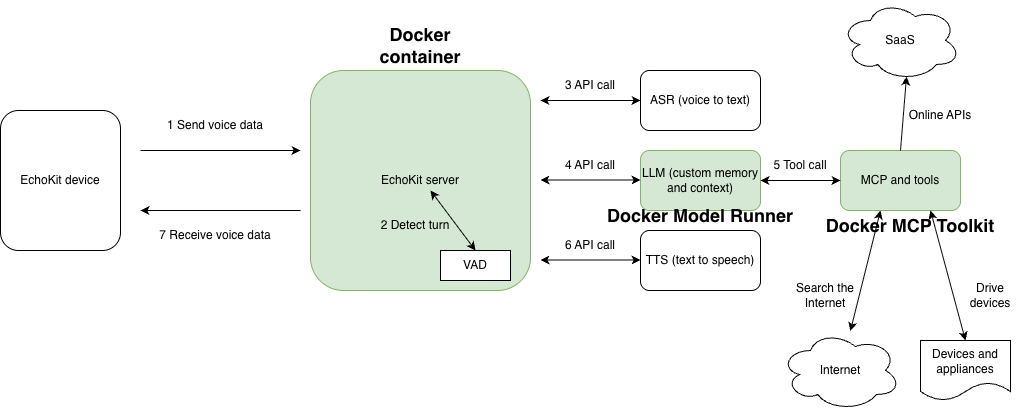

Inference Server dan Integrasi

Inference dijalankan melalui vLLM dalam container Docker berbasis stack NVIDIA.

Claude Code hanya membutuhkan endpoint kompatibel dengan Anthropic Messages API. vLLM telah mendukung format tersebut. Versi terbaru Ollama juga menyediakan kompatibilitas serupa.

Alur konfigurasi ringkas:

- Pull container

- Jalankan server vLLM

- Set environment variable endpoint

- Jalankan Claude Code

Tanpa proxy tambahan atau translation layer.

Non-Reasoning Model: Respons Cepat

Model bukan reasoning model yang menghasilkan chain of thought panjang. Output langsung ke solusi.

Untuk coding dan refactoring:

- Respons lebih cepat

- Context tidak membengkak

- Overhead token minimal

Tetap diperlukan verifikasi manual. Pada kasus kompleks, model dapat terdengar yakin namun keliru. Validasi akhir tetap tanggung jawab developer.

Apakah Investasi Layak

Workstation di atas 3.000 USD bukan segmen hobi. Namun untuk:

- Security researcher

- Reverse engineer

- Developer profesional dengan workload berat

Kontrol penuh atas data dan penghematan waktu dapat membenarkan investasi.

Pada sistem VRAM lebih kecil, sebagian layer MoE dapat di-offload ke RAM sistem dengan performa masih usable, walau tidak setara unified memory.

Ringkasan Teknis

Stack:

- Hardware: Lenovo ThinkStation PGX

- Model: Qwen3-Coder-Next

- Inference: vLLM

- Interface: Claude Code

Hasil:

- Performa mendekati coding assistant cloud

- Context sangat besar dan tetap usable

- Cocok untuk workflow agentic dan reverse engineering

- Tanpa ketergantungan API eksternal

Untuk pendekatan local-first yang benar-benar produktif, konfigurasi ini termasuk yang paling solid saat ini.

0 Komentar